Wenn du Code in ChatGPT einfügst, um einen Fehler zu debuggen, wohin geht dieser Code? Wer sieht ihn? Wenn er die proprietäre Logik deines Unternehmens, Kundendaten oder unveröffentlichte Features enthält, ist das relevant?

Die meisten Menschen behandeln KI-Privatsphäre binär: Entweder du kümmerst dich um Privatsphäre (und vermeidest KI-Tools vollständig), oder es ist dir egal (und du nutzt, was bequem ist). Aber diese Perspektive übersieht etwas Wichtiges. Die eigentliche Frage ist nicht, ob du KI-Tools nutzt. Es ist, mit wem du bereit bist, deine Daten zu teilen, und ob du diese Wahl bewusst triffst.

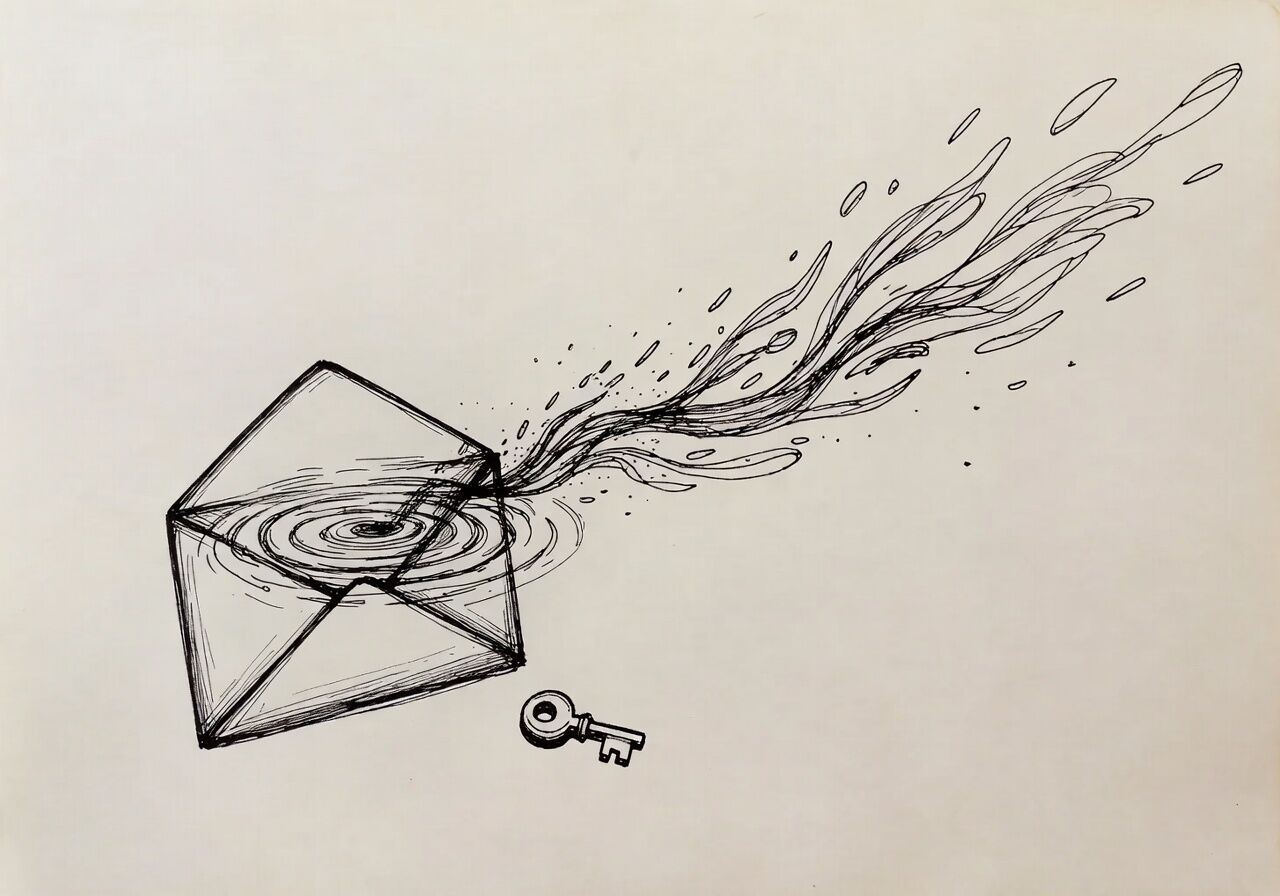

Der unsichtbare Datenfluss

Du weißt wahrscheinlich, dass deine Konversationen mit KI-Diensten an Unternehmensserver gesendet werden. Aber weißt du, was danach passiert?

Einige Dienste nutzen deine Daten explizit nicht für Training. Andere sind vage darüber. Manche speichern Konversationen unbegrenzt. Andere löschen sie nach 30 Tagen. Einige teilen Daten mit Drittpartner-Partnern. Manche nicht.

Die Details variieren stark zwischen Anbietern, und sie ändern sich. Ein Dienst, der deine Daten letztes Jahr nicht für Training nutzte, könnte seine Bedingungen aktualisiert haben. Das kostenlose Angebot, das du nutzt, könnte andere Privatsphäre-Regeln haben als das kostenpflichtige Business-Angebot.

Die meisten prüfen das nicht. Sie akzeptieren einfach die Standardeinstellungen und nehmen an, dass jemand anderes darüber nachgedacht hat.

Was "privat genug" tatsächlich bedeutet

Interessant ist: Nicht alle Daten brauchen denselben Schutz.

Ein Prompt zum Formatieren einer CSV-Datei? Wahrscheinlich in Ordnung bei jedem grösseren KI-Dienst. Der Entwurf der Quartalsstrategie Ihres Unternehmens? Das verdient mehr Prüfung. Ein Gespräch über berufliche Herausforderungen, das Kollegen namentlich nennt? Sie könnten sich dafür interessieren, wer das sieht.

Das Spektrum sieht ungefähr so aus:

Öffentliches Wissen und generische Aufgaben → Nutze, was bequem ist

Arbeitsbezogen, aber nicht sensibel → Prüfe, ob der Dienst deine Daten für Training nutzt

Vertrauliche Geschäftsinformationen → Erwäge lokale Modelle oder Dienste mit starken Privatsphäre-Garantien

Rechtlich geschützte Daten → Kenne deine Compliance-Anforderungen und prüfe, ob der Dienst diese erfüllt

Das Problem ist, dass die meisten Menschen alles gleich behandeln. Sie teilen entweder alles mit Cloud-Diensten oder vermeiden KI ganz wegen "Privatsphäre-Bedenken." Beide Ansätze verfehlen die Nuancen.

Die lokale Alternative, die Sie vielleicht nicht kennen

KI-Modelle lokal auf deinem Computer auszuführen bedeutet, dass deine Daten deine Maschine nie verlassen. Keine Server, keine Drittparteien, keine Nutzungsbedingungen zu lesen. Vollständige Kontrolle.

Vor ein paar Jahren waren lokale Modelle zu schwach, um nützlich zu sein. Das ändert sich. Nicht für alles, aber für viele häufige Aufgaben werden lokale Modelle ernsthaft leistungsfähig.

Es gibt natürlich einen Kompromiss. Lokale Modelle sind typischerweise weniger leistungsfähig als die grössten Cloud-basierten. Sie erfordern mehr Einrichtung. Sie funktionieren nicht für jeden Anwendungsfall.

Aber für sensible Arbeit könnte der Kompromiss es wert sein. Und während sich lokale Modelle verbessern, verschiebt sich diese Kalkulation.

Die Frage, die Sie stellen sollten

Wenn du ein KI-Tool nutzt, triffst du eine Entscheidung darüber, wem du mit deinen Daten vertraust. Manchmal ist diese Wahl bewusst und informiert. Oft ist sie es nicht.

Die Frage ist nicht "Sollte ich KI-Tools nutzen?" Sie lautet "Verstehe ich, wer Zugriff auf das hat, was ich teile, und bin ich damit einverstanden?"

Wenn du ChatGPT nutzt, um Code zu debuggen, der die Kern-Geschäftslogik deines Unternehmens enthält, ist das eine Entscheidung. Vielleicht ist es die richtige Entscheidung für deine Situation. Aber es sollte eine bewusste sein, nicht nur die Standardoption, weil ChatGPT das erste Tool ist, an das du gedacht hast.

Was sich kürzlich geändert hat

Die KI-Privatsphäre-Landschaft verschiebt sich. Grosse Anbieter bieten jetzt Business-Angebote mit stärkeren Privatsphäre-Garantien an. Lokale Modelle, die tatsächlich funktionieren, werden verfügbar. Privatsphäre-Regulierungen werden spezifischer bezüglich KI-Tools.

Aber die Standardeinstellungen haben sich nicht viel geändert. Wenn du nicht aktiv eine privatsphäre-fokussierte Option wählst, bekommst du wahrscheinlich keine.

Die Chance hier ist, deine Tool-Wahl an deine Datensensibilität anzupassen. Nicht alles braucht maximale Privatsphäre. Aber sensible Arbeit verdient mehr Überlegung als "Ich nutze einfach das KI-Tool, das bereits in meinem Browser offen ist."

Privatsphäre bei KI geht nicht darum, diese Tools zu vermeiden. Es geht darum, sie mit offenen Augen zu nutzen.